Votre premier réflexe pour lancer un projet IA est de vouloir recruter un "Data...

Votre premier réflexe pour lancer un projet IA est de vouloir recruter un "Data...

Utiliser ChatGPT dans un onglet séparé de votre navigateur, c'est comme avoir une...

Vous êtes convaincu du potentiel de l'IA, mais votre direction reste sceptique face à un...

"L'intelligence artificielle, c'est formidable, mais au final, combien ça coûte et,...

Le PoC (Proof of Concept) a été un succès. L'équipe était enthousiaste, les premiers...

En tant que manager, vous êtes en première ligne. Vous percevez le potentiel de l'IA...

Vous avez décidé d'encadrer l'usage de l'IA plutôt que de l'interdire. Excellente...

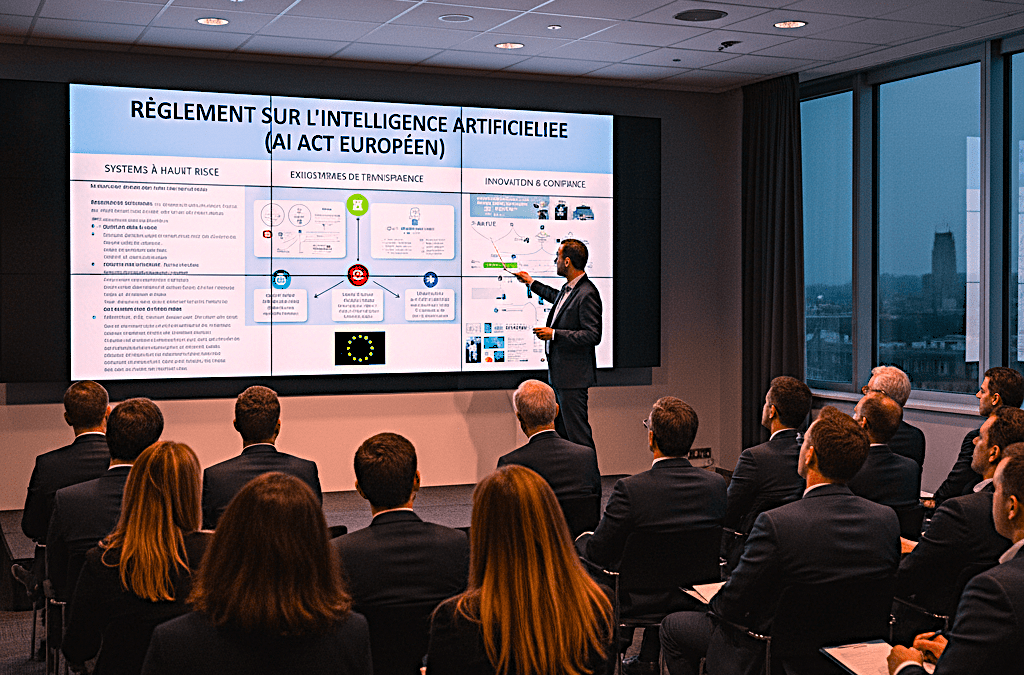

L'AI Act européen arrive, et avec lui son lot d'interrogations et d'inquiétudes pour les...

Vous êtes convaincu. L'intelligence artificielle n'est plus une option, c'est une...

Sans mesure, l'IA générative n'est qu'un gadget coûteux. Pour justifier les...

Vos collaborateurs utilisent déjà ChatGPT et d’autres IA génératives, que vous le sachiez ou non. Ce « Shadow IT » galopant expose votre entreprise à des risques majeurs : fuites de données confidentielles, non-conformité RGPD, informations erronées… Tenter de l’interdire est une bataille perdue d’avance. Et si, au lieu de le combattre, vous appreniez à le maîtriser ? Cet article vous donne la méthode pour encadrer l’usage de l’IA, transformer ce risque en un formidable atout pour l’innovation et la productivité, en toute sécurité.

Le « Shadow AI » désigne l’utilisation d’outils d’intelligence artificielle par les employés sans l’approbation ou la connaissance du département informatique ou de la direction. Poussés par la volonté d’être plus efficaces, ils se tournent vers des outils publics comme la version gratuite de ChatGPT. Si l’intention est louable, les conséquences peuvent être désastreuses.

C’est le risque le plus direct et le plus grave. Chaque information que vous entrez dans un modèle d’IA public peut potentiellement être utilisée pour entraîner de futurs modèles. Il n’y a aucune garantie de confidentialité.

Le Règlement Général sur la Protection des Données est très clair : en tant qu’entreprise, vous êtes le « responsable du traitement » des données personnelles de vos clients et employés.

Au-delà de la sécurité, il y a le risque lié à la qualité et la fiabilité des résultats.

Interdire est inefficace et contre-productif. La bonne approche consiste à gouverner, c’est-à-dire à fournir un cadre qui maximise les bénéfices tout en minimisant les risques.

La première étape est de formaliser les règles du jeu. Ce document doit être simple, clair et accessible à tous.

Les règles ne suffisent pas si vous ne proposez pas d’alternatives viables. L’objectif est de fournir aux équipes des outils aussi efficaces que ChatGPT, mais sécurisés.

Déployer un outil ne suffit pas. Il faut investir dans les compétences pour s’assurer qu’il est bien utilisé.

Une fois ce cadre en place, votre équipe marketing peut libérer sa créativité en toute confiance.

Votre équipe a besoin de trouver des slogans pour une nouvelle gamme de produits ? Au lieu d’utiliser un prompt vague comme « donne-moi des slogans », ils peuvent utiliser un outil sécurisé avec un prompt précis : « Agis comme un directeur de création. Propose 10 slogans pour une marque de café bio, équitable, destinée aux 25-35 ans urbains. Le ton doit être énergique et inspirant. » L’IA devient un partenaire de brainstorming inépuisable, sans aucun risque de fuite de votre stratégie de lancement.

Pour alimenter vos réseaux sociaux ou votre blog, l’IA peut être un formidable accélérateur. Elle peut générer des brouillons de posts, des structures d’articles, ou décliner un message sur différents formats. Le rôle de l’humain reste cependant crucial et non-négociable : c’est lui qui édite, personnalise, vérifie les faits, ajoute l’émotion et la touche finale qui fait la différence. L’IA produit la matière première, l’humain la transforme en un produit fini de qualité.

Votre équipe peut utiliser une IA sécurisée pour synthétiser des dizaines d’articles de presse, de rapports de marché publics ou les blogs de vos concurrents. Le prompt pourrait être : « Synthétise les 10 articles suivants sur les tendances du marché du véhicule électrique en Europe en un résumé de 500 mots, en identifiant les 3 principaux points de divergence entre les analystes. » L’IA effectue en quelques minutes un travail de synthèse qui aurait pris des heures, permettant à l’équipe de se concentrer sur l’analyse stratégique.

Le « Shadow AI » n’est pas un problème technique, c’est un symptôme de l’agilité de vos équipes et de leur désir de performance. Le rôle du management n’est pas de brider cet élan, mais de le canaliser. En établissant des règles claires, en fournissant des outils sécurisés et en formant vos collaborateurs, vous transformez une menace potentielle en un puissant levier d’innovation. Gouverner n’est pas interdire, c’est libérer le potentiel en toute confiance.

Passez à l’action : Vous voulez évaluer votre niveau d’exposition au Shadow AI ? Contactez-nous pour un diagnostic rapide.

Votre premier réflexe pour lancer un projet IA est de vouloir recruter un "Data...

Utiliser ChatGPT dans un onglet séparé de votre navigateur, c'est comme avoir une...

Vous êtes convaincu du potentiel de l'IA, mais votre direction reste sceptique face à un...

"L'intelligence artificielle, c'est formidable, mais au final, combien ça coûte et,...

Le PoC (Proof of Concept) a été un succès. L'équipe était enthousiaste, les premiers...

En tant que manager, vous êtes en première ligne. Vous percevez le potentiel de l'IA...

Vous avez décidé d'encadrer l'usage de l'IA plutôt que de l'interdire. Excellente...

L'AI Act européen arrive, et avec lui son lot d'interrogations et d'inquiétudes pour les...

Vous êtes convaincu. L'intelligence artificielle n'est plus une option, c'est une...

Sans mesure, l'IA générative n'est qu'un gadget coûteux. Pour justifier les...